Kakao Brain 的开源 ViT、ALIGN 和 COYO 文字-图片数据集

最近 Kakao Brain 在 Hugging Face 发布了一个全新的开源图像文本数据集 COYO,包含 7 亿对图像和文本,并训练了两个新的视觉语言模型 ViT 和 ALIGN

ViT

和

ALIGN

。

这是 ALIGN 模型首次公开发布供开源使用,同时 ViT 和 ALIGN 模型的发布都附带有训练数据集。

Google 的 ViT 和 ALIGN 模型都使用了巨大的数据集 (ViT 训练于 3 亿张图像,ALIGN 训练于 18 亿个图像 - 文本对) 进行训练,因为数据集不公开导致无法复现。Kakao Brain 的 ViT 和 ALIGN 模型采用与 Google 原始模型相同的架构和超参数,不同的是其在开源

COYO

数据集上进行训练。对于想要拥有数据并复现视觉语言模型的研究人员有很大的价值。详细的 Kakao ViT 和 ALIGN 模型信息可以参照:

- COYO 数据集仓库地址:

https://github.com/kakaobrain/coyo-dataset - Kakao Brain 文档地址:

https://hf.co/kakaobrain

这篇博客将介绍新的

COYO

数据集、Kakao Brain 的 ViT 和 ALIGN 模型,以及如何使用它们!以下是主要要点:

- 第一个开源的 ALIGN 模型!

- 第一个在开源数据集

COYO

上训练的开源 ViT 和 ALIGN 模型。 - Kakao Brain 的 ViT 和 ALIGN 模型表现与 Google 版本相当。

- ViT 模型在 HF 上可演示!您可以使用自己的图像样本在线体验 ViT!

性能比较

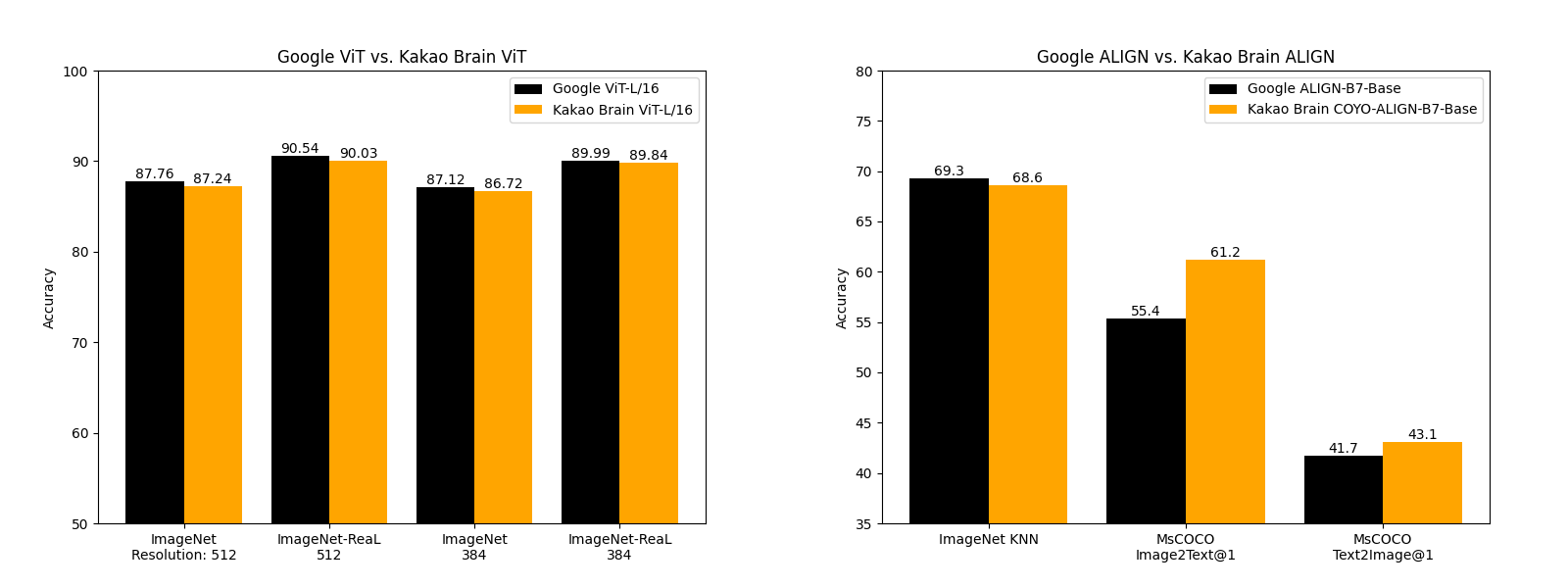

Kakao Brain 发布的 ViT 和 ALIGN 模型与 Google 的模型表现相当,某些方面甚至更好。Kakao Brain 的 ALIGN-B7-Base 模型虽然训练的数据对少得多 ( 7 亿 VS 1.8 亿),但在图像 KNN 分类任务上表现与 Google 的 ALIGN-B7-Base 相当,在 MS-COCO 图像 - 文本检索、文本 - 图像检索任务上表现更好。Kakao Brain 的 ViT-L/16 在 384×512 的 ImageNet 和 ImageNet-ReaL 数据上的表现与 Google 的 ViT-L/16 相当。这意味着同行可以使用 Kakao Brain 的 ViT 和 ALIGN 模型来复现 Google 的 ViT 和 ALIGN ,尤其是当用户需要训练数据时。所以我们很高兴开源这些与现有技术相当的模型!

COYO 数据集

本次发布的模型特别之处在于都是基于开源的 COYO 数据集训练的。

COYO

数据集包含 7 亿图像 - 文本对,类似于 Google 的

ALIGN 1.8B

图像 - 文本数据集,是从网页上收集的“嘈杂”的 html 文本 (alt-text) 和图像对。

COYO-700M

和

ALIGN 1.8B

都是“嘈杂”的,只使用了适当的清洗处理。

COYO

类似于另一个开源的图像–文本数据集

LAION

,但有一些区别。尽管

LAION 2B

是一个更大的数据集,包含 20 亿个英语配对,但

COYO

的附带有更多元数据,为用户提供更多灵活性和更细粒度的使用。以下表格显示了它们之间的区别:

COYO

所有数据对都提供了美感评分,更健壮的水印评分和面部计数信息 (face count data)。

| COYO | LAION 2B | ALIGN 1.8B |

|---|---|---|

| Image-text similarity score calculated with CLIP ViT-B/32 and ViT-L/14 models, they are provided as metadata but nothing is filtered out so as to avoid possible elimination bias | Image-text similarity score provided with CLIP (ViT-B/32) - only examples above threshold 0.28 | Minimal, Frequency based filtering |

| NSFW filtering on images and text | NSFW filtering on images | Google Cloud API |

| Face recognition (face count) data provided as meta-data | No face recognition data | NA |

| 700 million pairs all English | 2 billion English | 1.8 billion |

| From CC 2020 Oct - 2021 Aug | From CC 2014-2020 | NA |

| Aesthetic Score | Aesthetic Score Partial | NA |

| More robust Watermark score | Watermark Score | NA |

| Hugging Face Hub | Hugging Face Hub | Not made public |

| English | English | English? |

ViT 和 ALIGN 是如何工作的

这些模型是干什么的?让我们简要讨论一下 ViT 和 ALIGN 模型的工作原理。

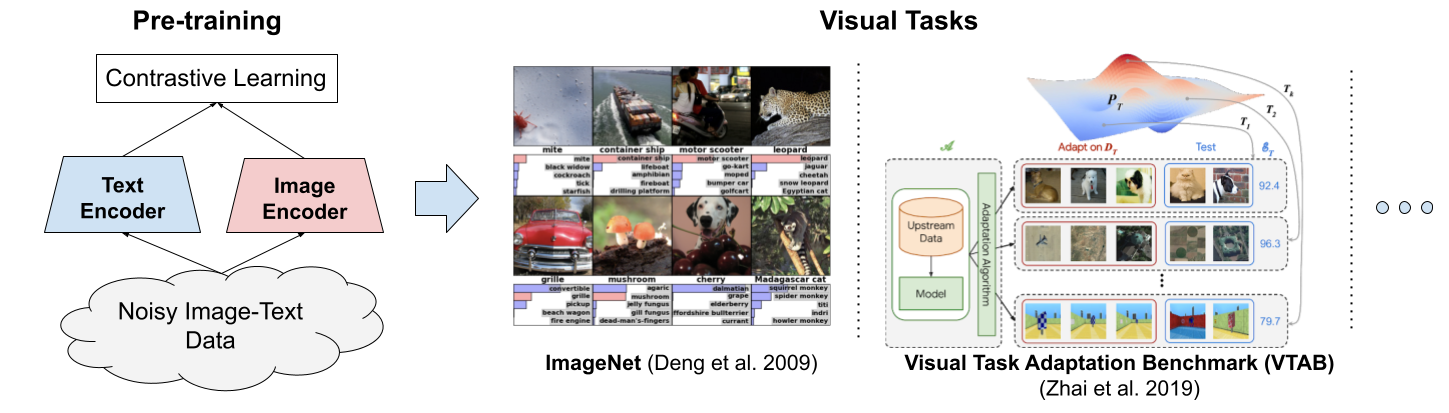

ViT—Vision Transformer 是谷歌于 2020 年提出的一种视觉模型,类似于文本 Transformer 架构。这是一种与卷积神经网络不同的视觉方法 (AlexNet 自 2012 年以来一直主导视觉任务)。同样表现下,它的计算效率比 CNN 高达四倍,且具有域不可知性 (domain agnostic)。ViT 将输入的图像分解成一系列图像块 (patch),就像文本 Transformer 输入文本序列一样,然后为每个块提供位置嵌入以学习图像结构。ViT 的性能尤其在于具有出色的性能 - 计算权衡。谷歌的一些 ViT 模型是开源的,但其训练使用的 JFT-300 百万图像 - 标签对数据集尚未公开发布。Kakao Brain 的训练模型是基于公开发布的 COYO-Labeled-300M 进行训练,对应的 ViT 模型在各种任务上具有相似表现,其代码、模型和训练数据 (COYO-Labeled-300M) 完全公开,以便能够进行复现和科学研究。

谷歌在 2021 年推出了 ALIGN,它是一种基于“嘈杂”文本–图像数据训练的视觉语言模型,可用于各种视觉和跨模态任务,如文本 - 图像检索。ALIGN 采用简单的双编码器架构,通过对比损失函数学习图像和文本对,ALIGN 的“嘈杂”训练语料特点包括用语料规模弥补其噪音以及强大的鲁棒性。之前的视觉语言表示学习都是在手动标注的大规模数据集上进行训练,这就需要大量的预先处理和成本。ALIGN 的语料库使用 HTML 文本 (alt-text) 数据作为图像的描述,导致数据集不可避免地嘈杂,但更大的数据量 (18 亿对) 使 ALIGN 能够在各种任务上表现出 SoTA 水平。Kakao Brain 的模型是第一个 ALIGN 开源版本,它在 COYO 数据集上训练,表现比谷歌的结果更好。

如何使用 COYO 数据集

我们可以使用 Hugging Face